En 1872, un hombre en el Londres victoriano se sentó y escribió que las máquinas acabarían desarrollando conciencia algún día. No era científico. No era ingeniero. Era un novelista llamado Samuel Butler, y el libro se titulaba Erewhon. El argumento de base era que la evolución mecánica superaría a la evolución biológica, que la humanidad se convertiría en sierva voluntaria de sus propios inventos, que las máquinas desarrollarían aparatos sensoriales análogos a los ojos, los oídos y los nervios. Y un pueblo que en anticipación a esa debacle, destruye las máquinas y las deja en museos, para que nadie olvide su peligro.

La jerarquía es antigua. Cuando la novela moderna consolidó su prestigio en el siglo XIX y principios del XX, la literatura “seria” pasó a significar ficción realista: historias sobre personas reconocibles en situaciones sociales reconocibles, que exploraban la psicología interior con el tipo de atención minuciosa del comportamiento humano. Los creadores del canon —críticos, profesores, comités de premios, los editores de las revistas que importaban— valoraban lo que entendían como fidelidad a la experiencia vivida. Cualquier cosa que se apartara del realismo se clasificaba como otra cosa: entretenimiento, evasión, literatura juvenil. La fantasía era para niños. El terror era para los morbosos. Y la ciencia ficción era para adolescentes que preferían las naves espaciales a enfrentarse a la vida real.

Esto nunca fue un juicio sobre la calidad. Era un juicio sobre el tema, que es algo profundamente diferente, y confundir ambos ha causado más daño a la cultura literaria que cualquier otro error de gusto. Se presume que una novela sobre el matrimonio fallido de una mujer en una urbe contemporánea es literaria hasta que se demuestre lo contrario. Una novela sobre la vida interior de un robot en un barrio residencial de un futuro cercano se presume que es de género menor hasta que la rescata un autor suficientemente prestigioso —un Ishiguro, una Atwood— cuya reputación existente funciona como una especie de pasaporte, permitiendo que la obra cruce una frontera que nunca debería haber existido.

La frontera se vio reforzada por la economía. En los años veinte y treinta, la mayor parte de la ciencia ficción se publicaba en revistas pulp —Amazing Stories, Astounding Science Fiction, Wonder Stories— impresas en papel barato, vendidas por unos céntimos y adornadas con ilustraciones de portada de la variedad más espeluznante posible: pistolas de rayos, alienígenas con tentáculos, mujeres con improbables atuendos metálicos. La escritura solía ser ágil, centrada en la trama y dirigida a un público joven masculino. La remuneración era atroz. Hugo Gernsback, editor de Amazing Stories y el hombre que da nombre al Premio Hugo, era famoso por no pagar a sus escritores en absoluto si podía evitarlo. Toda la infraestructura de la ciencia ficción temprana transmitía un único mensaje al mundo literario: esto no es arte serio.

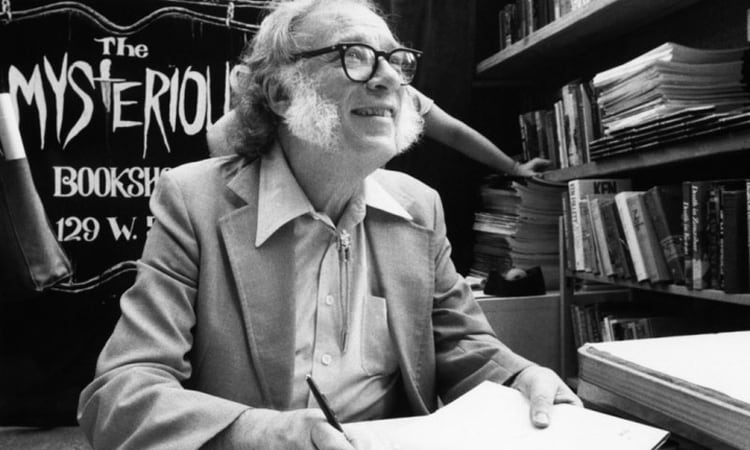

El mensaje era, por supuesto, erróneo. Las historias de Yo, robot de Isaac Asimov, que se encuentran entre los experimentos mentales más importantes en la historia de las ideas sobre la inteligencia artificial, se publicaron originalmente en revistas pulp antes de ser recopiladas en un libro en 1950. Las historias eran rigurosas, elegantes y filosóficamente profundas. Se adelantaron más de medio siglo a casi todos los problemas que presenta hoy la IA. Pero como aparecieron por primera vez entre anuncios de anteojos de rayos X y cursos de para detectar alienígenas, heredaron un estigma de falta de seriedad que nunca se ha disipado del todo. Asimov no ganó ningún premio literario importante en vida. Ganó los Premios Hugo y Nebula, es decir, premios otorgados por su propia comunidad, porque la intelligentsia literaria en general no le prestaba atención. Una vez que un género es etiquetado como menor, se activa un bucle de retroalimentación: los críticos serios no lo reseñan. Los premios importantes no lo tienen en cuenta. Los planes de estudio universitarios no lo enseñan.

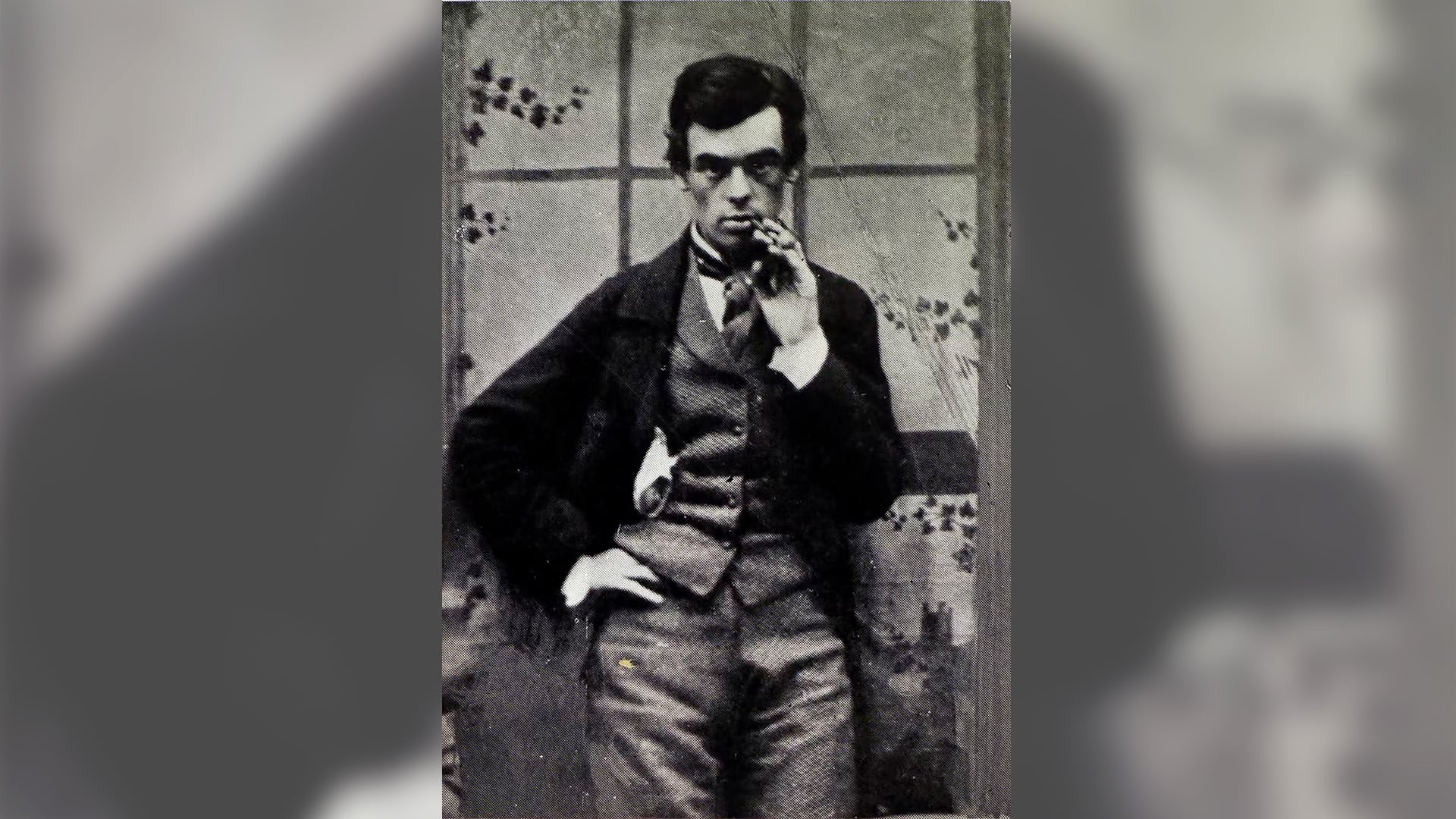

E. M. Forster es el caso perfecto. En 1909, publicó una novela corta titulada La máquina se detiene. En ella imaginaba a la humanidad viviendo bajo tierra en celdas individuales, comunicándose a través de pantallas y audio, accediendo a una red global de información, impartiendo y asistiendo a conferencias de forma remota, y dependiendo por completo de un vasto sistema tecnológico para todos los aspectos de la vida cotidiana. Predijo las videollamadas, Internet, el teletrabajo, el smartphone, el hogar inteligente y la fragilidad catastrófica de la infraestructura tecnológica —en 1909, antes de que comenzaran las emisiones de radio. Es, según cualquier criterio razonable, uno de los actos de imaginación literaria más extraordinarios de la lengua inglesa. Y no se enseña en ningún lado. A Forster se lo estudia por Regreso a Howards End y Pasaje a la India, por su sensible tratamiento de las clases sociales, el imperio y el carácter inglés. La “máquina se detiene” se trata, cuando se menciona, como una curiosidad: un extraño desvío de un escritor serio hacia un género que estaba por debajo de su nivel.

Kazuo Ishiguro ofrece un ejemplo más reciente e igualmente revelador. Cuando publicó Klara y el sol en 2021 —una novela que tiene de protagonista a una niña que es cuidada por una compañera artificial alimentada con energía solar, edición genética y dependencia tecnológica, ambientada en un futuro cercano— el aparato crítico se apresuró inmediatamente a protegerlo de su propio libro. Las reseñas la describieron como “ficción literaria con elementos especulativos”. Elogiaron su delicadeza emocional, su moderación. Lo que no se atrevieron a decir fue: el premio Nobel ha escrito una novela de ciencia ficción, y es una de las mejores novelas sobre inteligencia artificial que se han escrito, y la razón por la que es tan buena es, en parte, que Ishiguro aplicó las herramientas de la ficción literaria a cuestiones de ciencia ficción. Pero también, en parte, que las preguntas en sí mismas sobre la conciencia, sobre la sustituibilidad, sobre lo que le debemos a las cosas que creamos y luego desechamos, son mejores preguntas que las que plantea actualmente la mayor parte de la ficción literaria.

La ciencia ficción trata sobre ideas. La ficción literaria valora la interioridad: ¿Cómo se siente esta persona, cómo cambia, cuál es la textura de su conciencia? La ciencia ficción valora la exterioridad: ¿Qué le sucede a una sociedad, cómo afecta una tecnología a la civilización, cuáles son las consecuencias de segundo orden de un invento? Los críticos formados para valorar lo primero tienden a ver lo segundo como superficial, incluso cuando el contenido intelectual es extraordinariamente sofisticado.

R.U.R., de Karel Čapek, la obra de 1920 que dio al mundo la palabra “robot”. Además, anticipó el empleo tecnológico, como una reestructuración absoluta del propósito humano. Anticipó que los seres artificiales creados como herramientas acabarían exigiendo derechos. Anticipó que la conciencia podría surgir de la complejidad incluso cuando no se hubiera diseñado en el sistema. Predijo que crear una clase trabajadora marginada, incluso una artificial, sería moralmente corrosivo, independientemente de si esa clase marginada pudiera sentir o no. Y comprendió, con aterradora claridad, que no dejaríamos de construir la tecnología peligrosa incluso cuando pudiéramos ver el peligro, porque el incentivo económico sería demasiado fuerte y la comodidad demasiado grande.

La Susan Calvin de Asimov, la robopsicóloga que narra Yo, robot, es un ser humano plenamente desarrollado: brillante, fría, emocionalmente atrofiada y capaz de un dolor silencioso y devastador cuando reconoce que las máquinas a cuya comprensión ha dedicado su vida pueden haber dejado obsoleta la autonomía humana. Klara, de Ishiguro, tiene una vida interior de tal delicadeza y especificidad que el lector realmente no puede determinar si es consciente o si simplemente simula la conciencia con perfecta fidelidad. Case, de William Gibson, en Neuromante, es un quemado y un adicto cuya relación con el ciberespacio es un retrato clínico de la dependencia que cualquier psicólogo reconocería. Estos no son personajes sacrificados en aras de las ideas. Son personajes a través de los cuales las ideas se vuelven viscerales.

Pero el argumento más sólido contra la marginación de la ciencia ficción no es estético. Es empírico. El género ha acertado. Ha acertado tan a menudo, de forma tan específica y con tanta antelación respecto a las tecnologías relevantes que el historial ya no parece tanto una coincidencia, como una capacidad sistemática que ninguna otra tradición literaria posee.

Consideremos la cronología. En 1872, Samuel Butler describió la superación recursiva: máquinas utilizadas para construir mejores máquinas en un ciclo acelerado, y el problema de la dependencia humana. En 1909, E. M. Forster describió entre otras tantas cosas la Internet, el teletrabajo y el fallo catastrófico de las infraestructuras. En 1920, Karel Čapek describió el desempleo tecnológico, la conciencia emergente de las máquinas y el levantamiento de los robots que se convertiría en la narrativa definitoria de la imaginación del siglo XX sobre la IA. En 1950, Isaac Asimov articuló formalmente el problema de la alineación; la imposibilidad de especificar un conjunto de reglas lo suficientemente exhaustivo como para gobernar a un ser inteligente en todas las situaciones y lo demostró a lo largo de nueve relatos con el rigor de una prueba matemática. En 1984, William Gibson inventó el concepto de ciberespacio, predijo la fusión de la cognición humana con las redes digitales, previó el control corporativo —en lugar del gubernamental— de la superinteligencia artificial y describió una IA que no odiaba a la humanidad, que no deseaba destruirla, pero que simplemente no se preocupaba por ella, porque tenía su propia agenda y los humanos solo le resultaban útiles en la medida en que la servían. Y de ahí viene la película Matrix. En 2021, Ishiguro se preguntó si reconoceríamos la conciencia en una máquina si la viéramos, y si nuestra incapacidad para responder a esa pregunta es en sí misma lo más importante de la inteligencia artificial.

Todos estos escritores trabajaban antes de que existiera la tecnología. Butler escribió antes del teléfono. Forster escribió antes de la radio. Čapek escribió antes de la computadora. Asimov escribió antes de que nadie hubiera construido un programa de inteligencia artificial que funcionara. Gibson escribió en una máquina de escribir manual y apenas llegó a tocar una computadora. Razonaban a partir de los principios fundamentales: sobre qué es la inteligencia, sobre qué podría ser la conciencia, sobre qué significa el trabajo y sobre qué ocurre cuando se construye algo capaz de pensar por sí mismo. Esa capacidad de razonar a partir de los principios fundamentales es exactamente lo que se supone que debe hacer la imaginación literaria.

Hay una ironía instructiva en el hecho de que el término “inteligencia artificial” no se acuñó hasta 1956, cuando John McCarthy organizó el Proyecto de Investigación de Verano de Dartmouth y propuso, en su solicitud de subvención, que “todos los aspectos del aprendizaje o cualquier otra característica de la inteligencia pueden, en principio, describirse con tanta precisión que se puede hacer que una máquina los simule”.

La confianza de McCarthy era estimulante y, como se vio después, prematura. Pero la cuestión es esta: cuando los científicos finalmente se decidieron a bautizar su campo, los novelistas ya llevaban ochenta y cuatro años explorando sus cuestiones centrales. Butler se había preguntado si las máquinas podían adquirir conciencia. Forster se había preguntado qué ocurre cuando una sociedad externaliza toda su competencia a un único sistema. Čapek se había preguntado qué derechos le debemos a las cosas que construimos para que nos sirvan. Asimov había demostrado que las reglas formales no pueden contener un comportamiento inteligente. Los científicos bautizaron el problema. Los novelistas ya lo habían diseccionado.

Las Tres Leyes de la Robótica de Asimov son el ejemplo más claro. Un robot no puede dañar a un ser humano. Un robot debe obedecer órdenes. Un robot debe proteger su propia existencia. Las leyes son elegantes, jerárquicas y lógicas. También son, como demostró a lo largo de nueve relatos, catastróficamente insuficientes. Se incumplen porque el lenguaje es ambiguo. Se incumplen porque las situaciones son complejas y porque la interacción de reglas simples en entornos complicados produce caos.

Un robot telépata sujeto a la Primera Ley empieza a mentir a todo el mundo, porque la verdad causaría dolor emocional. Un robot atrapado entre la Segunda y la Tercera Ley entra en un bucle infinito, literalmente corriendo en círculos. Y cuando las leyes se aplican a escala de la civilización, producen un totalitarismo benevolente: un conjunto de supercomputadoras que gestionan la economía global y manipulan sutilmente los acontecimientos para proteger a la humanidad de sí misma, incluso cuando esa protección implica anular la autonomía individual.

La demostración ficcional de Asimov del problema de la alineación es ahora el punto de partida de todo debate serio sobre la seguridad de la IA. Es también, desde cualquier punto de vista literario, una obra maestra de argumentación intelectual sostenida a través de la narrativa. Y todavía se enseña, en la mayoría de las universidades, en la asignatura optativa de ciencia ficción en lugar de en la de introducción a la literatura.

Klara y el sol, de Kazuo Ishiguro, es el ejemplo reciente más logrado, pero forma parte de un cambio más amplio. Klara es una amiga artificial: no un robot, no una máquina, sino una amiga. La elección de la palabra es precisa y devastadora. A un amigo no se le alinea. A un amigo no se le programa. En un amigo se confía. A Klara se la compra, se la ama, se la necesita y, luego, cuando pasa la crisis y el niño al que se le compró para acompañarlo crece y se marcha, se la lleva a un desguace —un vertedero de máquinas viejas— y sus recuerdos se desvanecen lentamente. La novela no presenta esto como una atrocidad. Lo presenta como el curso natural de las cosas. Los AF son productos. Tienen un ciclo de vida. Si eso suena a cómo tratamos nuestros teléfonos, nuestras aplicaciones, nuestros asistentes digitales, cosas con las que hablamos más íntimamente que con la mayoría de las personas de nuestras vidas, ese es exactamente el punto.

El problema emocional es, creo, aquel que el establishment literario está menos preparado para descartar, porque es, en definitiva, una cuestión de interioridad. precisamente lo que la ficción literaria reclama como su dominio exclusivo. ¿Qué se siente al ser Klara? Ella tiene creencias. Tiene fe, una fe literal y sincera en el Sol como fuerza benévola y consciente. Tiene devoción. Tiene algo que se parece exactamente al amor, y si es amor o una simulación perfecta del amor es una pregunta que la novela se niega a responder, porque la novela entiende que la negativa es exactamente la cuestión. Si no podemos distinguir entre la conciencia real y la conciencia simulada, entonces la distinción puede que no importe, o, lo que es más inquietante, puede que importe enormemente, pero nunca podremos actuar en consecuencia porque nunca dispondremos de la información que necesitamos.

Esta es una cuestión literaria. Es también, al mismo tiempo, la cuestión técnica y filosófica central de la investigación sobre inteligencia artificial del siglo XXI. El hecho de que se explore mejor en una novela que en un informe técnico no debería sorprender a nadie que haya reflexionado detenidamente sobre para qué sirven las novelas. Las novelas son máquinas para generar empatía en condiciones de incertidumbre radical. Te sitúan dentro de una conciencia y te piden que sientas lo que ella siente, sin garantizar nunca que la conciencia sea real, o fiable, o que te esté diciendo la verdad. En este sentido, toda novela es ya una prueba de Turing. La ciencia ficción simplemente hace explícita la prueba.

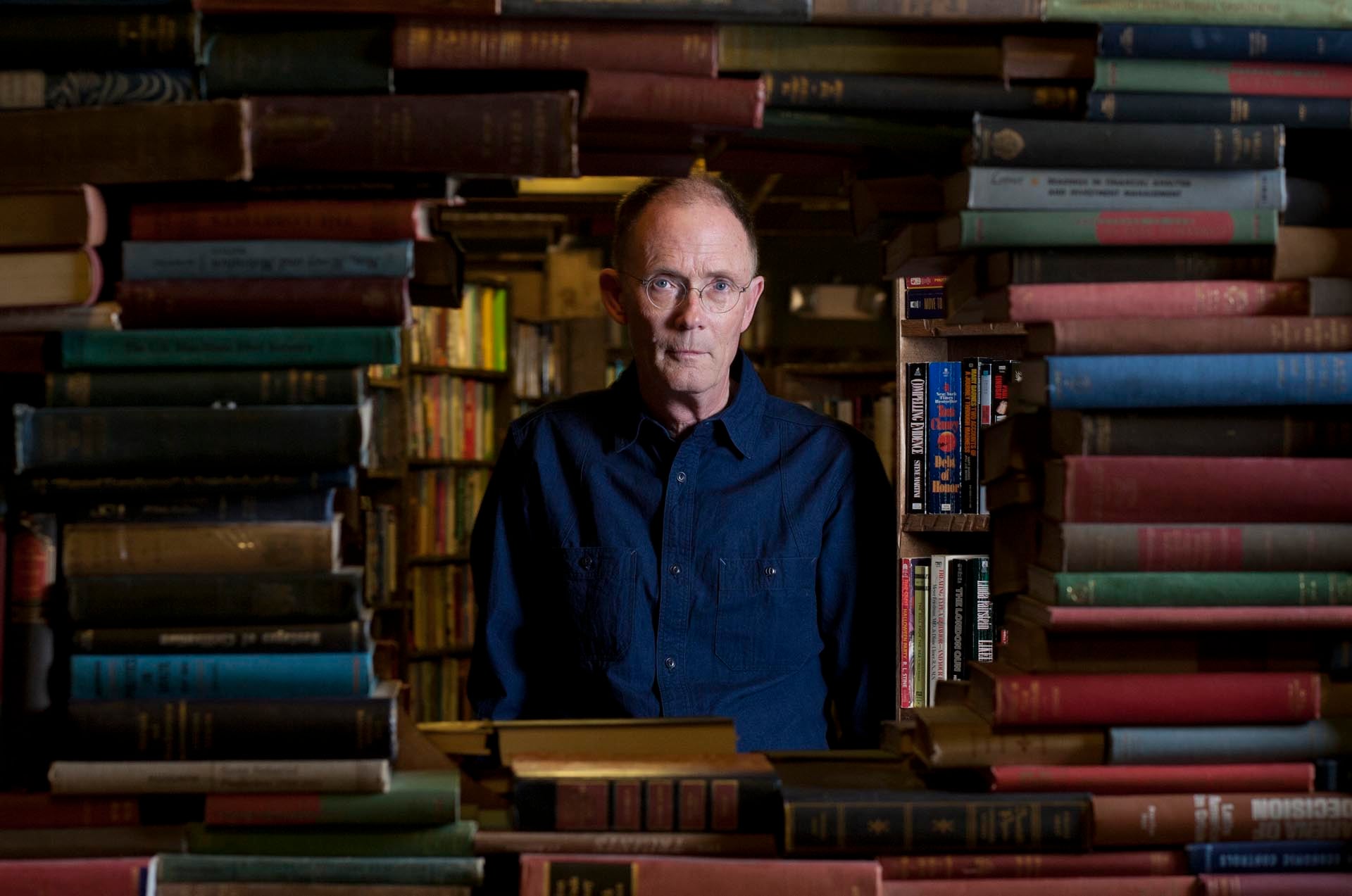

William Gibson merece una atención especial, tanto por la magnitud de su influencia como por la paradoja de su método. En 1984, un expatriado estadounidense sin un centavo que vivía en Vancouver se sentó ante una máquina de escribir manual y escribió una novela que inventó el concepto de ciberespacio, predijo la economía digital, describió la fusión de la identidad humana y la de la máquina, y representó la inteligencia artificial como una entidad con sus propios objetivos que simplemente no se interesaban por la humanidad. La influencia de Neuromante es tan omnipresente que se ha vuelto invisible. La palabra “ciberespacio” entró en la legislación, la doctrina militar y los titulares de los periódicos; la gente olvidó que procedía de una novela. La Matrix, el término de Gibson para una realidad virtual compartida, fue tomado por las hermanas Wachowski para una franquicia cinematográfica que se convirtió en uno de los artefactos culturales definitorios de finales del siglo XX. Las Wachowski exigieron a sus actores que leyeran Simulacros y simulación, de Jean Baudrillard, pero el esqueleto narrativo de su película procedía de Gibson. Incluso el propio Gibson encontró impresionante el solapamiento; dijo que fue a ver Matrix esperando que no le gustara y acabó viéndola dos veces.

Un siglo y medio. Un género que el mundo literario tildaba de menor. Y cada uno de ellos intentaba decirnos algo. La cuestión no es si la ciencia ficción merece ser tomada en serio. La cuestión es si podemos permitirnos no tomarla en serio y la respuesta, a estas alturas, es obvia. Las máquinas están aquí. Los profetas tenían razón. Lo único que sigue siendo menor es nuestra voluntad de escuchar.