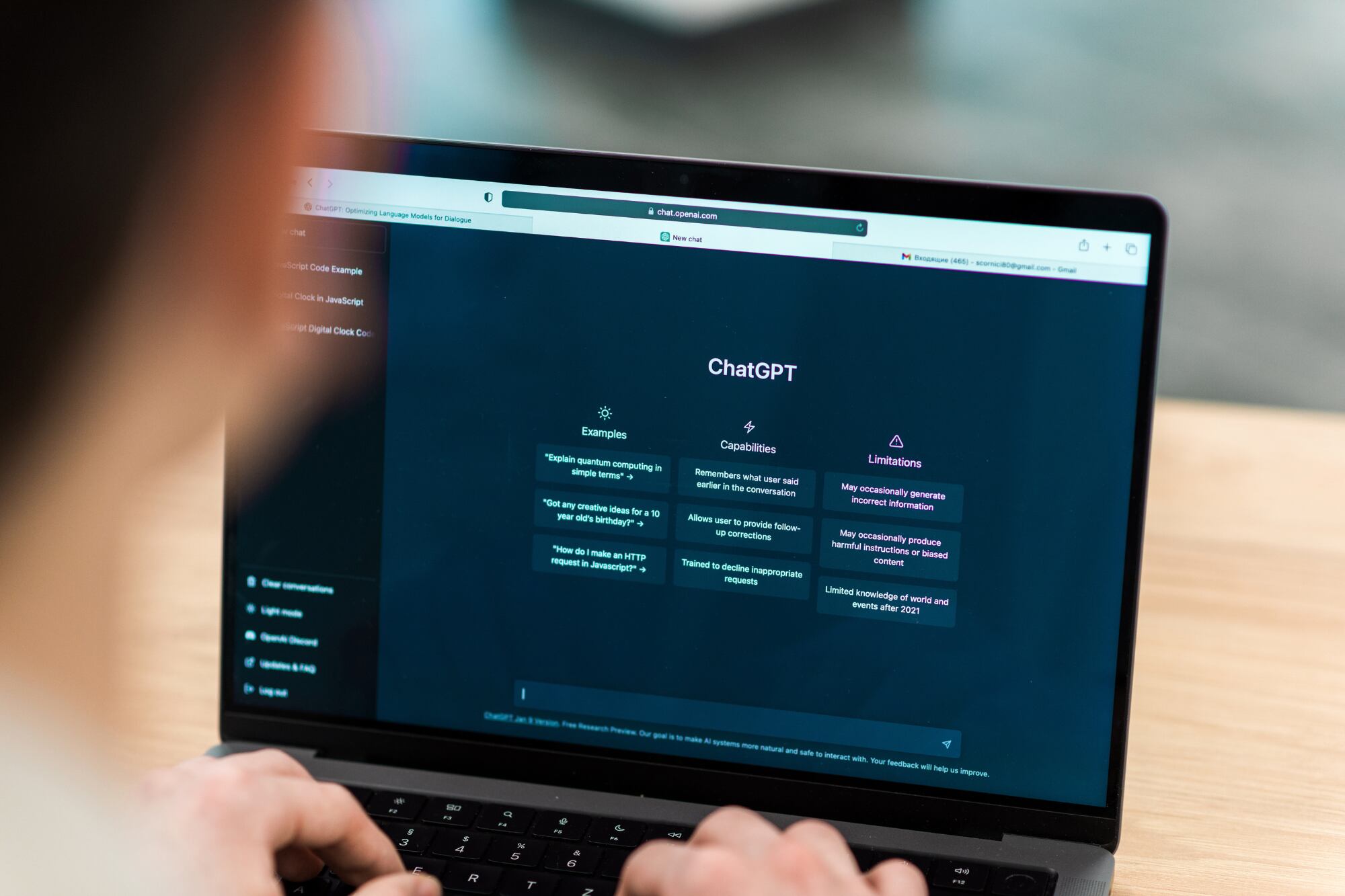

Algunos días atrás, la respuesta de un sistema diseñado para detectar si un contenido fue generado por inteligencia artificial sorprendió al público y despertó una inquietante pregunta: ¿estamos en una era en la que ya no será posible distinguir las producciones humanas de lo que fue hecho por la IA?

Cómo los asistentes de IA y las capacitaciones virtuales le enseñan finanzas a personas de más de 55 años

La consulta a la herramienta era en relación a este texto: “Fue en una lúgubre noche de noviembre cuando contemplé la culminación de mis esfuerzos. Con una ansiedad que casi rozaba la agonía, reuní a mi alrededor los instrumentos de la vida, para poder infundir una chispa de ser en la cosa inerte que yacía a mis pies. Era ya la una de la madrugada; la lluvia golpeaba tristemente contra los cristales, y mi vela estaba casi consumida cuando, a la tenue luz casi extinguida, vi abrirse el opaco ojo amarillo de la criatura; respiró con dificultad, y un movimiento convulsivo agitó sus miembros”.

Los lectores más avispados habrán reconocido el texto, un fragmento perteneciente a la obra Frankenstein, novela escrita por la reconocida Mary Shelley, hace 200 años. Ahora bien, la sorpresa llegó cuando la herramienta consultada aseguró que se trataba de un texto “100% generado por IA”.

To confirm, this “100% AI generated” passage is the opening of chapter 5 from Mary Shelley’s Frankenstein pic.twitter.com/6uOs7qDGoD

— Benji (@WrnrWrites) March 24, 2026

En un contexto en que cada vez más personas se ven tentadas a usar IA para escribir trabajos del colegio, redactar documentos jurídicos o escribir un libro, herramientas como ZeroGPT o Turnitin surgieron con el objetivo de detectar la presencia de IA o de plagio. Estos sistemas fueron ganando popularidad en instituciones educativas, editoriales y estudios de abogacía, ya que incluso pueden reconocer un texto que fue parafraseado (identificar la copia de la esencia de ciertos contenidos, aunque el texto original sea distinto). Y aunque poco a poco se extiende el uso de estas herramientas, pueden resultar instrumentos peligrosos, si se tiene en cuenta que a veces se las utiliza para tomar decisiones en juicios, universidades y otros ámbitos profesionales. “Se le está pidiendo a estas herramientas que resuelvan algo que ni los humanos podemos resolver con certeza. Mientras tanto, se usan para tomar decisiones reales sobre escritores, estudiantes y profesionales, sin que nadie audite cómo funcionan por dentro”, comparte Mariano Cassero, CTO de Finnegans, tecnológica que desarrolla software ERP y soluciones de gestión digital.

Los comentarios de la publicación de X vinculados a Frankenstein también se muestran escépticos frente a estas herramientas y llegan a asegurar que el mejor remedio para este problema es dejar de utilizar estos recursos: “Solución simple: dejá de usar ZeroGPT, es considerablemente peor para detectar prosa generada por IA que yo”, señala un usuario, mientras que otro agrega: “Esto solo demuestra que esos detectores en realidad no entienden la escritura”.

Por qué la tripulación de la Artemis II usa computadoras de hace 10 años en la nave Orion

Marcelo de Luca, cofundador de The App Master, una software factory con más de 15 años de experiencia en el desarrollo de soluciones digitales, coincide con estas miradas y opina: “En cuanto a detección de plagio, la realidad es que hoy no existe una tecnología confiable para detectar si algo fue generado por IA o no. Las herramientas disponibles tienen tasas de error inaceptables para cualquier uso legal serio”.

¿Por qué las herramientas de detección de contenido generado por IA se equivocan?

Para entender los errores en los que caen estos dispositivos, es importante conocer cómo funcionan. “El problema principal de estas herramientas es que no detectan si un texto fue escrito por inteligencia artificial: detectan si un texto tiene una distribución estadística de palabras similar a la que producen los modelos de lenguaje”, indica Agustín Raimondi, abogado y fundador de la empresa de legal tech Welaw.

Raimondi explica que los modelos de lenguaje generan texto eligiendo la siguiente palabra más probable dado el contexto anterior. Este sistema produce textos con palabras predecibles, estructuras formales y poca variación sintáctica. Las herramientas miden justamente esos patrones, pero el problema es que muchos textos humanos cuentan con esas mismas características.

De Luca coincide y se describe como “escéptico frente a cualquier sistema que pretenda resolver esto con un porcentaje de confianza”. Indica que los mismos patrones que buscan las herramientas de detección de IA también aparecen en textos humanos, especialmente en escritura técnica, académica o muy estructurada.

Cassero agrega que los modelos fueron entrenados con enormes volúmenes de texto. De esta forma, “cuando procesan un fragmento con el que fueron entrenados, lo reconocen como familiar, no porque lo hayan generado, sino porque ya lo vieron”.

“Desde el punto de vista jurídico podemos decir que ningún detector de IA está en condiciones de funcionar como prueba en un proceso legal o disciplinario justamente por esas fallas estructurales. No tiene metodología validada ni tasa de error estandarizada”, es contundente el abogado Raimondi.

¿Cuál es la mejor forma de detectar si algo fue generado por IA?

Los expertos coinciden en que no existe un único método en el que se pueda confiar para verificar si ciertos textos fueron o no generados por IA. Sin embargo, recomiendan ciertas prácticas de transparencia que podrían ayudar a esta detección.

Poetas, actores y filósofos. Quiénes están enseñándole a la IA a ser más humana

En primer lugar, se habla de las “marcas de agua criptográficas”, es decir, incluir ciertas indicaciones detectables, aunque invisibles, que permitan identificar el origen del output. Es el caso de China, por ejemplo, donde la regulación exige watermarking de contenido IA y el registro de modelos generativos.

Otros especialistas sugieren hacer un análisis que combine una serie de herramientas: buscar perplejidad (si el texto es predecible), pero también hacer un análisis de burst (indagar en el ritmo, detectar si hay escritura irregular, propia de los humanos, que, por ejemplo, alternan oraciones cortas y largas de forma impredecible) y analizar la coherencia semántica (ya que la IA suele ser muy consistente, mientras que las personas tienen saltos, ambigüedades o contradicciones). “Lo que sí funciona es el criterio humano combinado con contexto: conocer al autor, su historial, su voz, las inconsistencias entre lo que produjo antes y lo que hace ahora. No es un algoritmo, es juicio”, agrega Cassero.

Entre otras de las sugerencias, recomiendan registrar en los metadatos del archivo si el contenido fue generado por inteligencia artificial (son datos “ocultos” dentro de un archivo que describen cosas como, quién lo creó, cuándo se creó, con qué herramienta y en qué dispositivo). En el caso de la Unión Europea, la AI Act, vigente desde el 2024, incluye obligaciones de transparencia sobre datos de entrenamiento y requiere que los desarrolladores divulguen los datos de entrenamiento. De Luca señala que la mejor solución es la “honestidad radical”. Agrega que “ninguna herramienta técnica va a resolver esto de manera confiable en el corto plazo”, pero explica que lo que sí funciona es “construir culturas organizacionales y profesionales donde declarar el uso de IA sea la norma, no la excepción”.

En entornos legales o académicos, Raimondi señala que la mejor forma de determinar si el texto es o no es humano sigue siendo el proceso en sí mismo (versiones del documento, historial de edición, capacidad del autor de explicar sus decisiones). De Luca agrega que el criterio más confiable sigue siendo el humano, aunque reconoce que es un criterio difícil de escalar: “Un editor experimentado, un profesor que conoce el estilo de sus alumnos, un director creativo que sabe cómo piensa su equipo, van a detectar algo que no encaja mucho mejor que cualquier algoritmo”.

“Sin lugar a dudas la carrera entre generación y detección la va ganando la generación. Esto tiene lógica, ya que la principal preocupación es cómo podemos seguir automatizando procesos, no cómo podemos ver si esos procesos fueron automatizados. En definitiva pareciera ser que la solución a largo plazo es regulatoria (obligación de divulgación) y cultural (normas de transparencia), no puramente técnica”, concluye Raimondi.